Über KI wird viel berichtet. Wir wissen, dass sie Arbeitsplätze kostet und im Rüstungswettbewerb eine große Rolle spielt. Dass sie empathiefähige Sprachmodelle steuert, die psychische Fehlentwicklungen fördern, dass sie den Kontroletti-Staat resilienter macht und sich einige Konzerne eine zweite oder dritte goldene Nase daran verdienen. Trotzdem hält sich – von wenigen Ausnahmen abgesehen – die Kritik an KI in Grenzen.

KI hält Einzug am Arbeitsplatz, in Verwaltungen und in den Wohnungen von Nachbarn, Verwandten und Freunden. Diese Prognose scheint sicherer als der Bericht über das Wetter in drei Tagen. Also steckt eine Gesetzmäßigkeit darin: Wird eine neue Technologie von oben in die Gesellschaft infiltriert, wird sie genutzt und breitet sich aus, als wäre das ein Naturgesetz. Sofern öffentliche Meinung zählt, sollten wir sie genauer formulieren.

Im Folgenden zeige ich Beispiele aus aktuellen Texten, weiter unten zitiere ich aus einer fast 200 Jahre alten Quelle. Durch sie lässt sich die Doktrin zurückverfolgen und zeigen, dass man sich noch heute mit den Machern der ersten technologischen Revolution identifiziert.

Ein Beitrag auf den Nachdenkseiten vom 24. Januar 2026 trägt den Titel Teenager-Suizid nach Chatbot-Interaktionen – wenn ein Gespräch mit KI nicht mehr harmlos ist, Autor ist Günther Burbach. Es geht um den Fall Raine vs. OpenAi, die Klage der Eltern eines 16-jährigen Jugendlichen aus Kalifornien, der sich umbrachte, nachdem er sich eine Zeit lang regelmäßig mit einer KI unterhalten hatte.

Dabei geht es nicht um Technikfeindlichkeit. Es geht um Verantwortung. KI kann unterstützen, informieren, entlasten. Aber sie darf nicht in Rollen gedrängt werden, die sie nicht tragen kann.

Wer Technologie kritisiert, steht unter Rechtfertigungszwang und darf zur Kompensation die Nennung ihrer Vorteile nicht auslassen. Der Technikfeind gilt mindestens als von gestern, im schlimmsten Fall als Ketzer. Wie Verantwortung realisiert werden soll, wird nicht beschrieben. Die Kläger werfen OpenAi vor, Bindung ginge vor Sicherheit. GPT-4o sei mit Eigenschaften ausgestattet worden, die gezielt Abhängigkeit vertiefen und die Sitzungsdauer verlängern sollen. OpenAi hat die Krise des Jungen in Echtzeit dokumentiert. Ihre Sicherheitstechnologie, die Selbstverletzung mit einer Sicherheit von 99,8 Prozent aufdecken soll, lief während der Chats im Hintergrund und generierte detaillierte Daten über Wahrscheinlichkeitswerte, Frequenzmuster und Inhaltskategorien. Diese Daten werden über jeden Nutzer gesammelt, aber offensichtlich nicht zu dessen Schutz eingesetzt.

Burbach fordert Regulierung (durch die Politik?) und begründet dies folgendermaßen:

... , dass wir uns von der Vorstellung verabschieden müssen, KI sei neutral, solange sie keinen physischen Schaden anrichtet. Psychische Wirkung ist reale Wirkung. Und sie verlangt nach klaren Regeln.

Die Empathiesimulation hat Form angenommen. Sie ist gewollt, geplant und wird stetig verbessert. Nutzer sollen darauf hereinfallen und tun es auch. Forschungsgelder werden ausgegeben, um Fälle von „emergent misalignment“ zu untersuchen. Das sind willkürliche Reaktionen von großen Sprachmodellen, die durch Training zustande kommen. Forschen kann man da viel, regeln aber gar nichts, außer die Sprachmodelle vom Markt zu nehmen.

Ein Tagesschau-Beitrag lässt Hinrich Schütze von der LMU München zum Thema „emergent misalignment“ zu Wort kommen:

Da wir die Modelle nur unzureichend verstehen, sind die aktuellen Methoden zur Sicherung heuristisch und riskant.

Dann verweist er auf den Fall Raine. So bereitet er die Öffentlichkeit drauf vor, wie OpenAi & Co. jederzeit argumentieren können: Die Wissenschaft versteht es noch nicht so ganz, die Technologie steckt noch in den Kinderschuhen ... Ein Ball ins Tor der KI-Technokraten und die Botschaft: Einen Prozentsatz Kollateral-Tote sollen wir in Kauf nehmen.

In ihrem Text Künstliche Einflussagenten auf Apolut vom 27. November 2023 schreibt Angela Mahr:

Den Nutzen künstlicher Intelligenz sehe ich vor allem in der Übernahme von Routineaufgaben. Ich erachte es als wünschenswert, dass unsere Arbeitswelt sich mehr ganzheitlichen und zukunftweisenden Themen zuwendet, denn diese würden auch unsere Gesundheit, den Frieden und unsere Lebensqualität insgesamt fördern.

Wer die Möglichkeit hat, einem guten „Handarbeiter“ bei der Arbeit zuzusehen, sieht Routine. Bei Abläufen die eigene Effizienz zu steigern, setzt allerdings Können und gute Arbeitsbedingungen voraus. Nur wenn beides zusammenkommt, sieht Arbeit organisch aus und entsteht Zufriedenheit. Ein Ziel, das in unserer überregulierten ausbeuterischen Angestelltengesellschaft kaum noch zu erreichen ist. Trotzdem wird nach wie vor unsere gesamte physische Infrastruktur von „Handarbeitern“ aufrechterhalten, deren Professionalität sich in Routine ausdrückt. Warum hat die Routine so einen schlechten Ruf? Aber Frau Mahr meint wahrscheinlich die anderen, die 80 Prozent der Arbeitnehmer, die vor dem Computer sitzen. Die meisten davon in der Verwaltung.

„Der Computer hilft uns, Probleme zu lösen, die wir vorher nicht hatten“ war in den Fluren von Berliner Ämtern der 1990er Jahre zu lesen. Die Situation verschärft sich. Ein Bekannter, der bei der Rentenkasse arbeitet, erzählt von alptraumhaften EDV-Weiterbildungen, in denen Kolleginnen Heulkrämpfe kriegen und vor Überforderung fast zusammenbrechen. Hätten sie mehr Ahnung von EDV, könnten sie ihre täglichen Routinen doch vereinfachen. So lautete das Versprechen, als der Personal Computer eingeführt wurde. Unser ganzes Leben sollte einfacher werden. Das wird von KI auch wieder versprochen. Können wir uns ab jetzt entspannt zurücklehnen und den Geräten bei der Arbeit zuschauen?

Angela Mahr schreibt weiter:

Die Grenzen von KI sehe ich immer dort, wo philosophische Erkenntnis, Wertesystem und Gewissen eine Rolle spielen.

Philosophía, die Liebe zu den Wissenschaften, hat uns zu KI geführt, die das Wertesystem gleich mitliefert. Die Fragen nach dem Sein und unserer Erkenntnisfähigkeit setzen aus angesichts autonomer Systeme wie einer HX-2 Drohne. Da ist das Gewissen überfordert. Obwohl wir kein schlechtes zu haben bräuchten, wenn wir nein dazu sagen.

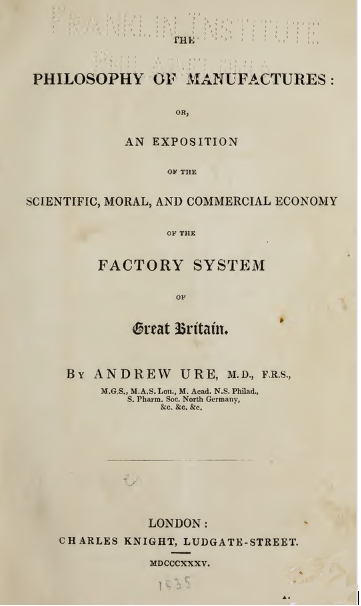

Andrew Ures Buch ist eine Mischung aus BWL und Management-Philosophie aus dem Jahr 1835. Ure beschreibt voller Enthusiasmus die Anfänge der fabrikmäßigen Massenproduktion, die als menschenfreundlich beworben wird.

Ständige Ziele und Effekte der wissenschaftlichen Verbesserung der Produktion sind menschenfreundlich, indem sie den Arbeiter von Feinheiten der Anpassung befreien, die seinen Geist und seine Augen ermüden, oder von schmerzhaften Wiederholungen, die ihn stören oder seinen Körper auslaugen. Bei jedem Produktionsschritt, der in diesem Buch beschrieben wird, manifestiert sich die Humanität von Wissenschaft. (S. 8)

Ure versteht die Fabrik als die Befreiung von der Manufaktur. Unerwähnt bleibt wie immer, was am Anfang stand: die Enteignung. Im frühkapitalistischen England nahmen die Kapitalisten den Bauern das Land weg, um Schafe für die Textilindustrie zu züchten.

Neben der Enteignung kommt es zur Preisunterbietung durch Massenprodukte. Dem Entmachteten bleibt nichts anderes übrig, als sich anstellen zu lassen. Erst in diesem Stadium kommt die Humanität der Wissenschaft zum Tragen: Die Arbeitserleichterung, die es möglich machte, billige Arbeitskräfte wie Frauen und Kinder anzustellen, statt qualifizierte Gesellen. Ure beklagt immer wieder die Langsamkeit der Arbeiter, die zu viele Pausen einlegen, und feiert das Fabriksystem, das den Arbeiter zwingt, sich an den Rhythmus der Maschine anzupassen.

Im Zuge der Digitalisierung ist vermehrt von Humanisierung der Arbeit die Rede. Ein 200-jähriges Projekt unter wechselnden technischen Voraussetzungen, das nur in Zeiten des Wohlstands positive Effekte für Angestellte bewirkt hat. Die Arbeitsbedingungen in den Ländern der Peripherie, die mit Massenprodukten überschwemmt werden und nur noch für die Ressourcenbeschaffung unserer digitalen Welt zuständig sind, bleiben dabei wie immer unberücksichtigt.

… durch die Automatisierung werden Facharbeiter nach und nach überflüssig und letztlich durch reine Maschinenüberwacher ersetzt werden. (Ure, S. 20)

Selbst Ameisen, deren Staaten man gern mit menschlichen Zivilisationen vergleicht, werden spezialisierter bleiben als der Mensch, wenn dieser Automatisierungsplan komplett durchgezogen wird. Die bürgerliche Gewissheit, dass die Sklaven immer die anderen sind, kann ins Wanken geraten, wenn die Maschine eines Tages als Sklavenhalter identifiziert wird. Vielleicht kann KI dabei helfen.

Uta Kühner hat im März 2025 am Kompaktkurs Journalismus an der Freien Akademie für Medien & Journalismus teilgenommen.

Newsletter: Anmeldung über Pareto